Part 5: Simulation & Training · Get it working in virtual worlds first

Chapter 15

NVIDIA Isaac Sim - 机器人的“元宇宙”

你玩过《模拟城市》或者《我的世界》吗?你在里面建房子、铺道路、放 NPC,然后看整个世界运转起来。现在把“城市”换成“仓库”,把“NPC”换成“机器人”,把“游戏引擎”换成一个有真实物理模拟的仿真平台 - 这就是 Isaac Sim 在做的事。

只不过,游戏引擎的物理可以“差不多就行”(角色穿墙大家笑笑就过了),机器人仿真的物理必须尽可能接近真实 - 因为你的目标不是做一个好看的 demo 视频,而是让在仿真里训练好的算法能直接搬到真机上跑。上一章我们讲了为什么需要仿真,这一章来看最主流的仿真工具到底长什么样、怎么用。

Isaac Sim 是 NVIDIA 推出的机器人仿真平台,底层基于 Omniverse 技术栈。它的核心卖点是高保真 - 物理引擎精度高(用的是 PhysX 5)、渲染效果好(支持光线追踪)、传感器模拟逼真(仿真 LiDAR 输出的点云格式和真实 LiDAR 一样)。如果说 Gazebo 是机器人仿真的”记事本”,Isaac Sim 更像是”Photoshop” - 功能强大,但吃配置、上手曲线陡。

从 URDF 到 USD - 把机器人“请进”虚拟世界

在 Isaac Sim 里干活,第一步永远是把你的机器人模型导进来。

你在第 7 章已经见过 URDF 了 - 那个描述机器人关节、连杆和传感器位置的 XML 文件。但 Isaac Sim 不直接用 URDF,它用的是 OpenUSD(Universal Scene Description),一种由皮克斯发明、后来被 NVIDIA 大力推广的 3D 场景描述格式。你可以把 USD 理解为 3D 世界的“HTML” - 它不只描述一个机器人,而是描述整个场景:地面的材质、灯光的位置、货架上每个物体的摆放。

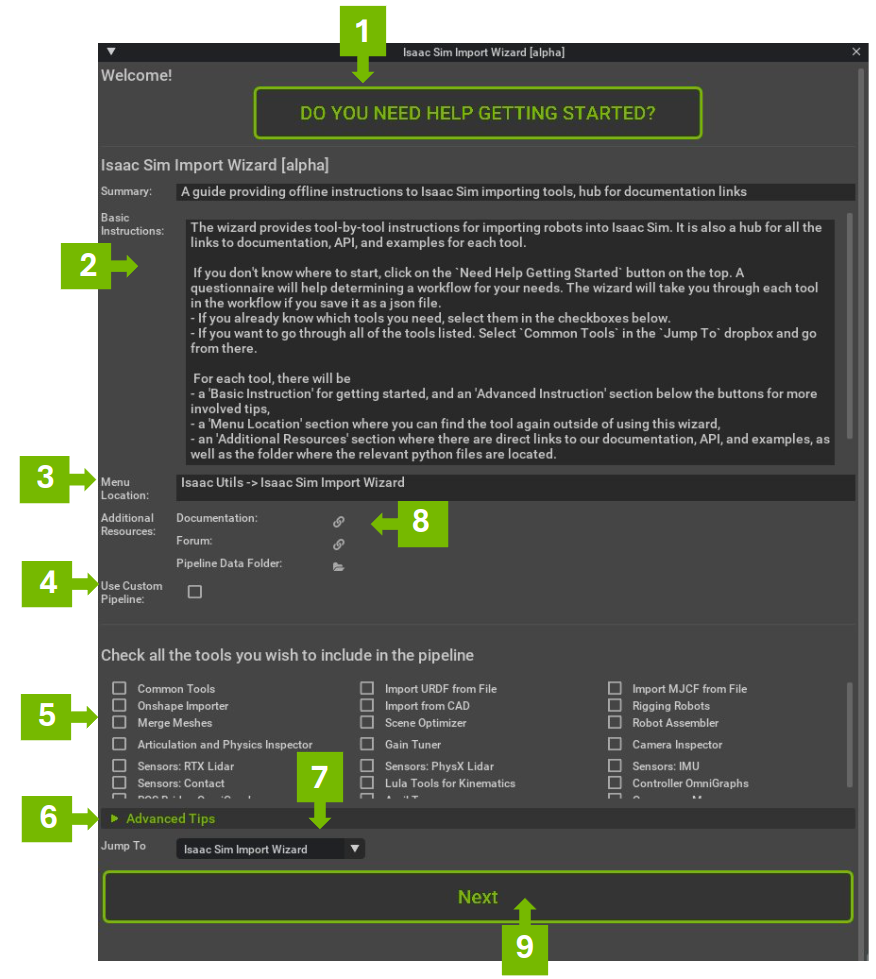

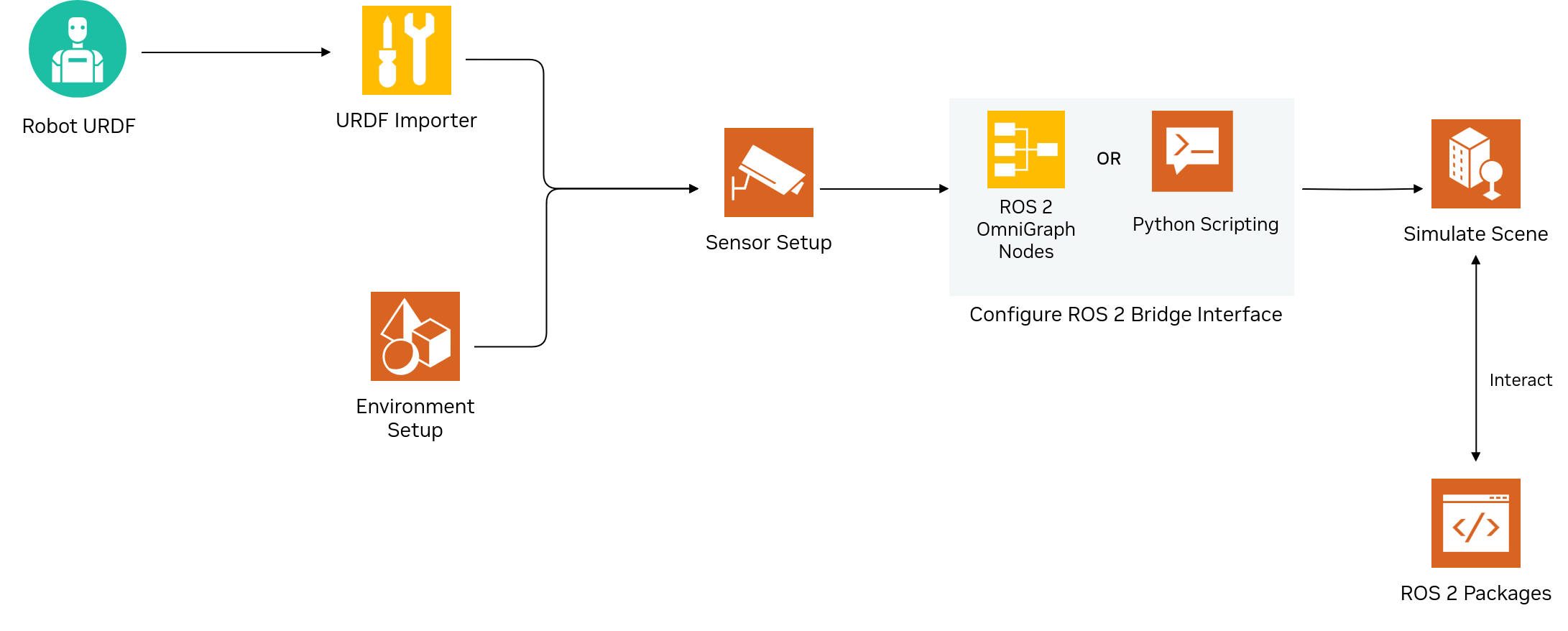

实际操作是这样的:Isaac Sim 自带 URDF Importer,你把 URDF 文件丢进去,它会自动转换成 USD 格式。转换过程中你需要设定一些物理属性 - 关节的阻尼系数、连杆的碰撞几何体、摩擦力参数。这些参数直接影响仿真结果的真实程度,后面讲 sim-to-real gap 的时候会回到这个问题。

对于常见的机器人(宇树的机器狗、Franka Emika 机械臂、TurtleBot),Isaac Sim 的 asset 库里已经有现成的 USD 模型。如果你是入门阶段,建议直接用这些预置模型,省去调物理参数的麻烦。

核心工作流:搭场景、挂传感器、接 ROS 2

一个典型的 Isaac Sim 开发流程分五步,理解这个流程比记住任何具体 API 都重要:

第一步:搭建场景。 Isaac Sim 提供了一些预置场景(仓库、办公室、简易房间),你也可以从零开始搭。场景里包括地面、墙壁、货架、桌子、各种物体。每个物体都有物理属性 - 质量、摩擦系数、弹性系数。你甚至可以导入 CAD 模型来复刻真实的工作环境。对于做物流仓储场景的团队,这一步通常花的时间最长 - 因为仓库的精确复刻直接决定了导航算法在真实仓库里的表现。

第二步:放入机器人。 把 USD 格式的机器人模型放到场景中的指定位置。如果你有多台机器人(比如模拟一个车队),这里就放多台。

第三步:添加传感器仿真。 这是 Isaac Sim 最有价值的部分之一。你可以在机器人上“安装”虚拟传感器 - RGB 相机、深度相机、LiDAR、IMU,它们输出的数据格式和真实传感器完全一致。仿真相机输出标准的图像消息,仿真 LiDAR 输出标准的点云消息。下游算法完全不知道数据来自仿真还是真机。

第四步:连接 ROS 2。 这是关键一步。Isaac Sim 通过内置的 ROS 2 Bridge,把仿真环境里的传感器数据发布到标准的 ROS 2 topic 上。你的 Nav2 节点、MoveIt 节点、感知节点 - 它们订阅的是同样的 topic 名字,处理的是同样格式的消息。换句话说,你的整个软件栈不需要改一行代码,就能从仿真环境切换到真机环境(理论上)。

第五步:运行和调试。 点击 Play,物理引擎开始跑,传感器开始出数据,ROS 2 节点开始处理。你可以在 Isaac Sim 的界面里实时看到机器人在仿真世界里移动,同时在 RViz 里看到 Nav2 的 costmap 和规划路径。

这五步的核心思想其实就一句话:在仿真里复现你在真机上的完整软件栈,只替换掉物理世界和传感器硬件。

Isaac Lab - 当你需要同时跑几千个机器人

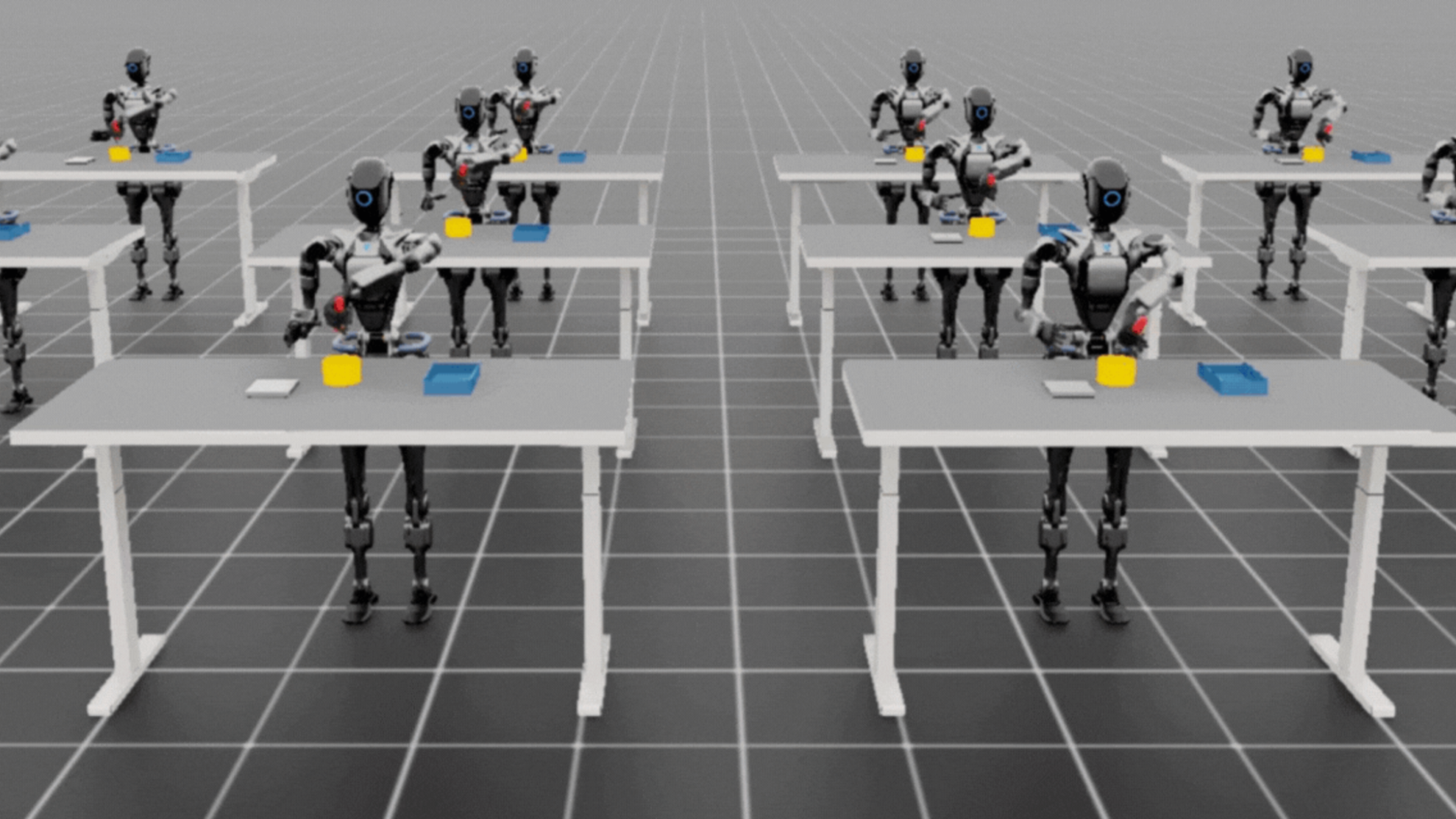

Isaac Sim 适合做单个场景的仿真验证,但如果你要训强化学习 policy,一个场景不够用 - 你需要同时跑成千上万个并行环境,让 agent 以极快的速度积累经验。

这就是 Isaac Lab(之前叫 Isaac Gym,后来重构整合进了 Isaac Lab)干的事。

Isaac Lab 的核心能力是 GPU 加速的并行仿真。传统仿真器是 CPU 跑物理,一个场景就占一个 CPU 核心,想并行就得开几千个进程 - 这既慢又吃内存。Isaac Lab 把物理仿真全部搬到 GPU 上,用 NVIDIA 的 PhysX / Warp 做并行计算。一张 RTX 4090 就能同时跑 4096 个机器人实例,每个实例都有自己的物理环境。

这意味着什么?假设一个 RL 训练循环需要机器人尝试 100 万次,单个仿真器可能需要跑几周,Isaac Lab 可以压缩到几小时。宇树机器狗那些看起来很酷的翻跟头、跑酷动作,背后的步态 policy 就是在这种大规模并行仿真中训练出来的。

Isaac Lab 集成了主流的 RL 框架 - RSL-RL、Stable Baselines3、rl_games。你定义好环境(observation space、action space、reward function),选一个算法(PPO 是目前机器人 RL 最常用的),剩下的就是调奖励函数和跑实验。下一章会专门讲强化学习,这里只需要知道:Isaac Lab 是目前机器人 RL 训练的事实标准基础设施。

一个容易混淆的点:Isaac Sim 和 Isaac Lab 不是同一个东西。Isaac Sim 偏向“高保真单场景仿真 + ROS 2 集成”,适合算法验证和系统集成测试;Isaac Lab 偏向“大规模并行仿真 + RL 训练”,适合训练 policy。它们底层共享 NVIDIA 的物理引擎和渲染技术,但面向的使用场景不同。

Gazebo - 开源世界的老大哥

在 NVIDIA 砸钱打造 Isaac 生态之前,Gazebo 统治了机器人仿真十几年。它是 Open Robotics 维护的开源仿真器,和 ROS 深度绑定 - 几乎所有 ROS 教程里的仿真都是用 Gazebo 跑的。

怎么选?取决于你当天要干什么。

场景一:你在调 Nav2 参数,让轮式机器人在走廊里不撞墙。 你需要的是快速启动、改参数、重跑、看结果。Gazebo 几秒钟就能启动,你的笔记本就能跑,改完 yaml 重启仿真接着调。用 Isaac Sim 干这个事就像开着卡车去便利店买瓶水 - 能到,但没必要。Nav2 和 MoveIt 的官方教程默认就是 Gazebo 环境,整个 ROS 2 生态围绕它建的。

场景二:你在训灵巧手的抓取 policy,需要精确的接触力学。 这时候 Gazebo 的 ODE / Bullet 物理引擎就不够用了 - 手指和物体的微小接触力差异会直接决定 policy 能不能迁移到真机。PhysX 5 在这类场景下的精度明显更高,这个差距会直接反映在 sim-to-real 的效果上。

场景三:你要用仿真批量生成训练数据,训练一个物体检测模型。 Gazebo 的 OpenGL 渲染出的图像一看就是"仿真味" - 光照平淡、材质塑料感。Isaac Sim 支持光线追踪,渲染出来的图像更接近真实照片,拿来训练的感知模型在真实环境里泛化能力更强。

很多团队的实际策略是两个都用:日常开发和快速迭代用 Gazebo(快、轻、免费、不挑显卡),需要高保真仿真或批量数据生成时切到 Isaac Sim/Lab。 这不是二选一的关系,而是不同阶段的工具切换。

值得一提的是,Gazebo 自身也在演进。新一代 Gazebo(之前叫 Ignition Gazebo,现在直接叫 Gazebo,版本号从 Fortress、Garden 到 Harmonic)在架构上做了大幅重构,模块化程度更高,渲染质量也有提升。但整体上,在高保真仿真这个维度上,它和 Isaac Sim 的差距仍然明显。

Sim-to-Real Gap - 仿真的“致命弱点”

上一章讲了 sim-to-real gap 的概念 - 仿真和真实世界之间的差距。这里不重复那些分类(物理参数、传感器噪声、视觉外观、动力学近似 - 回顾请看第 14 章),而是讲一个在 Isaac Sim 里调试这个 gap 的真实场景,帮你理解这个问题到底怎么咬人。

一个常见的故事:你在 Isaac Sim 里搭好了仓库场景,机器人用 Nav2 导航,跑了几百次测试,成功率 98%,信心满满地推到真机。结果真机第一天就开始撞货架边角。排查了两天,发现问题出在 URDF 转 USD 时碰撞体的设定上 - 仿真里货架腿用的是简化的长方体碰撞体,比真实货架腿窄了 2 厘米。仿真里机器人"刚好能过"的缝隙,真机上就是"刚好撞上"。Nav2 的算法没问题,costmap 的参数也没问题,bug 藏在仿真环境的建模精度里。

这类问题特别阴险,因为它们不会在仿真里报错,一切看起来都很正常。你只有在真机上跑出问题后,才会回头去检查仿真环境的每个物理细节。这就是为什么前面说"URDF 导入后第一件事是检查物理行为" - 很多 sim-to-real 的坑不是算法的问题,而是仿真环境本身没搭对。

Domain Randomization - 用“故意加噪”来对抗 gap

既然不可能让仿真完美匹配真实世界,那换一个思路:让训练过程见过足够多的“不完美”,这样模型就不会过度依赖仿真里的特定条件。

这就是 Domain Randomization(域随机化)的核心思想,它是目前最主流的 sim-to-real 迁移策略。

具体做法是,在训练过程中随机化仿真环境的各种参数:

- 物理参数:每次 reset 环境时,随机改变摩擦系数、物体质量、关节阻尼

- 视觉参数:随机改变光照方向和强度、纹理颜色、背景图案

- 传感器参数:随机改变噪声水平、延迟、偶尔丢帧

- 初始条件:随机改变物体的初始位置和姿态

这样训出来的 policy 不是在“一个仿真环境”里表现最优,而是在“一大堆不同条件的仿真环境”里都能还行。真实世界的条件大概率落在这个随机化范围内,所以 policy 的迁移效果通常比固定参数训练好得多。

这个方法最早由 OpenAI 在 2017 年的一篇工作中推广,他们用 domain randomization 成功让一只仿真训练的灵巧手在真机上做到了魔方还原。后来这个思路成为了机器人 RL 的标准配置。

踩坑提醒: domain randomization 不是万能的。随机化范围太小,覆盖不到真实世界的情况;太大,训练变得困难甚至收敛不了。找到合适的范围本身就是一个需要反复实验的过程。一个常见的做法是先在真机上采集一小批数据,测量真实的物理参数范围,然后据此设定随机化边界 - 这叫 system identification,比盲猜要靠谱得多。

开发者踩坑指南

显卡要求是硬门槛。 Isaac Sim 需要 NVIDIA RTX GPU,而且推荐至少 RTX 3070 + 16GB 显存。如果你的开发机是 MacBook 或者集成显卡,连装都装不了。很多开发者第一次接触 Isaac Sim 的挫败感不是来自软件本身,而是发现自己的硬件不够。解决方案要么是买一张合适的显卡,要么用 NVIDIA 的云端实例。Gazebo 在这方面友好得多 - 它在大多数配置上都能跑。

URDF 到 USD 的转换不是点一下就完事。 转换过程中碰撞几何体经常出问题 - URDF 里的碰撞体可能是简化的凸包,但在 Isaac Sim 里你可能需要更精确的碰撞网格,否则机器人会“悬浮”或者“穿模”。关节的运动范围、驱动模式(position control vs velocity control vs effort control)都需要在转换后仔细检查。建议把 URDF 导入后的第一件事设为:让机器人在空场景中跑几个基本动作,确认物理行为合理。

ROS 2 Bridge 的时钟同步。 Isaac Sim 有自己的仿真时钟,ROS 2 系统也有自己的时钟。如果两边时钟不同步,你会看到 TF(坐标变换)报错、传感器数据时间戳对不上、Nav2 规划出奇怪的路径。记得在 launch 配置里把 use_sim_time 设为 true,让 ROS 2 节点使用仿真时钟而不是系统时钟。这个小参数不对,能让你花几天排查一个“看起来什么都对但行为不正常”的 bug。

它的输出是什么,谁在用

Isaac Sim 的输出不是单一的 - 它取决于你用它干什么:

如果你用它做算法验证,输出是“你的 Nav2/MoveIt 软件栈在仿真环境中的运行结果” - 机器人走没走到目标点、手臂抓没抓到物体、有没有撞到障碍物。这些结果告诉你算法逻辑对不对,然后你带着这份信心去真机上部署。

如果你用它做感知数据生成,输出是大量带标注的图像和点云数据 - 物体的 bounding box、像素级 segmentation mask、6DoF 位姿标注。这些数据直接喂给你的感知模型训练流水线。因为是仿真生成的,标注是自动的、完美的,不需要人工标注。

如果你用 Isaac Lab 做 RL 训练,输出是一个训好的 policy 网络 - 给它当前的 observation(传感器读数、关节状态),它输出 action(关节力矩或目标位置)。这个 policy 是下一章要讲的强化学习的核心产出物。

仿真不是终点。它是连接“算法开发”和“真机部署”的桥梁 - 在这座桥上,你的代码第一次离开了纯软件的世界,开始和物理打交道,哪怕这个物理还是模拟的。